Así lo explica IBM

https://www.ibm.com/es-es/think/topics/artificial-intelligence

La inteligencia artificial (IA) es una tecnología que permite a los ordenadores y a las máquinas simular el aprendizaje, la comprensión, la resolución de problemas, la toma de decisiones, la creatividad y la autonomía humanas.

Las aplicaciones y dispositivos equipados con IA pueden ver e identificar objetos. Pueden comprender y responder al lenguaje humano. Pueden aprender de nueva información y experiencia. Pueden hacer recomendaciones detalladas a los usuarios y expertos. Pueden actuar de forma autónoma, por lo que no es necesaria la inteligencia o intervención humana (un ejemplo clásico es un coche autónomo).

Sin embargo, en 2024, la mayoría de los investigadores y profesionales del ámbito de la IA, así como la mayoría de las noticias relacionadas con esta tecnología, se centran en los avances de la IA generativa, una tecnología capaz de crear textos, imágenes, vídeos y otros contenidos originales. Para comprender plenamente la IA generativa, es importante conocer primero las tecnologías en las que se basan las herramientas de IA generativa: el machine learning (ML) y el deep learning.

- El machine learning, que consiste en crear modelos mediante el entrenamiento de un algoritmo para que realice predicciones o tome decisiones basadas en datos. Abarca una amplia gama de técnicas que permiten a los ordenadores aprender de los datos y hacer inferencias basadas en ellos sin estar explícitamente programados para tareas específicas. Uno de los tipos más populares de algoritmos de machine learning es la red neuronal (también conocida como red neuronal artificial). Las redes neuronales se basan en la estructura y el funcionamiento del cerebro humano. Están compuestas por nodos interconectados que procesan información de manera similar a las neuronas biológicas. Son muy adecuadas para tareas que implican identificar patrones y relaciones complejos en grandes cantidades de datos.

- El deep learning es un subconjunto del machine learning que utiliza redes neuronales multicapa, llamadas redes neuronales profundas, que simulan de manera más cercana el complejo poder de toma de decisiones del cerebro humano. Permiten el aprendizaje no supervisado: pueden automatizar la extracción de características de conjuntos de datos grandes, no etiquetados y no estructurados, y hacer sus propias predicciones sobre lo que representan los datos. Es muy adecuado para el procesamiento del lenguaje natural (PLN), la visión artificial y otras tareas que implican la identificación rápida y precisa de patrones y relaciones complejos en grandes cantidades de datos. Algunas formas de deep learning impulsan la mayoría de las aplicaciones de inteligencia artificial (IA) en nuestras vidas hoy en día.

Cómo funciona la IA generativa

En general, la IA generativa funciona en tres fases:

- Entrenamiento, para crear un modelo fundacional.

- Ajuste, para adaptar el modelo a una aplicación específica.

- Generación, evaluación y ajustes adicionales, para incrementar la precisión.

1. Entrenamiento

La IA generativa comienza con un "modelo fundacional"; un modelo de deep learning que sirve de base para múltiples tipos diferentes de aplicaciones de IA generativa.

Los modelos fundacionales más comunes hoy en día son los modelos de lenguaje de gran tamaño (LLM), creados para aplicaciones de generación de texto. Pero también hay modelos fundacionales para la generación de imagen, vídeo, sonido o música, y modelos fundacionales multimodales que soportan varios tipos de contenido.

El entrenamiento proporciona una red neuronal de miles de millones de parámetros (representaciones codificadas de las entidades, patrones y relaciones en los datos) que puede generar contenido de forma autónoma en respuesta a las instrucciones.

2. Ajuste

A continuación, el modelo debe ajustarse a una tarea específica de generación de contenido. Esto se puede hacer de varias maneras, entre ellas:

- El ajuste fino, que consiste en alimentar el modelo con datos etiquetados específicos de la aplicación (preguntas o prompts que la aplicación probablemente recibirá) y las correspondientes respuestas correctas en el formato deseado.

- El aprendizaje por refuerzo con comentarios humanos (RLHF), donde los usuarios humanos evalúan la precisión o relevancia de los outputs del modelo, de modo que éste pueda mejorarse a sí mismo. Esto puede ser tan sencillo como hacer que la gente escriba o responda con correcciones a un chatbot (Nota 1) o asistente virtual.

3. Generación, evaluación y más ajuste

Los desarrolladores y los usuarios evalúan periódicamente los outputs de sus aplicaciones de IA generativa y ajustan el modelo, incluso una vez a la semana, para mejorar su precisión y relevancia. Por el contrario, el modelo fundacional se actualiza con mucha menos frecuencia, quizá una vez al año o cada 18 meses.

Otra opción para mejorar el rendimiento de una aplicación de IA generativa es la generación aumentada por recuperación (RAG), una técnica para ampliar el modelo fundacional y utilizar fuentes relevantes fuera de los datos de entrenamiento para refinar los parámetros y lograr una mayor precisión o relevancia.

Un agente de IA es un programa de inteligencia artificial autónomo capaz de realizar tareas y alcanzar objetivos en nombre de un usuario o de otro sistema sin necesidad de intervención humana. El agente diseña su propio flujo de trabajo y utiliza las herramientas disponibles (otras aplicaciones o servicios).

La IA agéntica es un sistema compuesto por múltiples agentes de IA cuyas acciones se coordinan u orquestan para llevar a cabo una tarea más compleja o alcanzar un objetivo más ambicioso de lo que podría lograr cualquier agente del sistema por sí solo.

A diferencia de los chatbots y otros modelos de IA que operan dentro de restricciones predefinidas y requieren intervención humana, los agentes de IA y la IA agéntica exhiben autonomía, un comportamiento orientado a objetivos y adaptabilidad a circunstancias cambiantes. Los términos "agente" y "agéntico" se refieren a la agencia de estos modelos, o su capacidad para actuar de forma independiente y decidida.

Los modelos de IA generativa se centran en crear contenido basado en patrones aprendidos, mientras que los agentes utilizan ese contenido para interactuar entre sí y con otras herramientas con el fin de tomar decisiones, resolver problemas y completar tareas. Por ejemplo, una aplicación de IA generativa podría indicarle cuál es el mejor momento para escalar el Everest teniendo en cuenta su horario de trabajo. Sin embargo, un agente no solo se lo dirá, sino que también utilizará un servicio de viajes en línea para reservarle el mejor vuelo y una habitación en el hotel más cómodo de Nepal.

La IA ofrece numerosos beneficios en diversos sectores y aplicaciones. Algunas de las ventajas más citadas son

- Automatización de tareas repetitivas.

- Más conocimiento y más rápido a partir de los datos.

- Mejora de la toma de decisiones.

- Menos errores humanos.

- Disponibilidad 24x7.

- Reducción de riesgos físicos.

IA DÉBIL E IA FUERTE

IA débil: también conocida como “IA limitada”, se refiere a los sistemas de IA diseñados para realizar una tarea o un conjunto de tareas específicas. Los ejemplos podrían incluir aplicaciones de asistente de voz “inteligentes” como Alexa de Amazon, Siri de Apple, un chatbot de redes sociales o los vehículos autónomos prometidos por Tesla.

IA fuerte: también conocida como “inteligencia general artificial” (AGI) o “IA general”, posee la capacidad de entender, aprender y aplicar los conocimientos en una amplia gama de tareas a un nivel igual o superior a la inteligencia humana. Este nivel de IA es actualmente teórico y ningún sistema de IA conocido se acerca a este nivel de sofisticación. Los investigadores sostienen que, si la IA general fuera posible, sería necesario un gran aumento de la potencia de cálculo. A pesar de los recientes avances en el desarrollo de la IA, los sistemas de IA autoconscientes de la ciencia ficción se mantienen firmemente en ese ámbito.

¿QUÉ SON LAS ALUCINACIONES DE IA?

La alucinación de la IA es un fenómeno en el que un modelo de lenguaje de gran tamaño (LLM), a menudo un chatbot de IA generativa o una herramienta de visión artificial, percibe patrones u objetos que son inexistentes o imperceptibles para los observadores humanos, creando resultados que no tienen sentido o son completamente inexactos. (Nota 2)

Por lo general, si un usuario realiza una solicitud a una herramienta de IA generativa, desea un resultado que aborde adecuadamente la instrucción (es decir, una respuesta correcta a una pregunta). Sin embargo, a veces los algoritmos de IA producen outputs (respuestas) que no se basan en datos de entrenamiento, son decodificados incorrectamente por el transformador o no siguen ningún patrón identificable. En otras palabras, “alucina” la respuesta, especialmente en el caso del reconocimiento de imágenes o de patrones, por ejemplo, donde los resultados pueden tener un aspecto verdaderamente surrealista.

Estas interpretaciones erróneas se producen debido a varios factores, como el sobreajuste, el sesgo/inexactitud de los datos de entrenamiento y la alta complejidad del modelo.

La alucinación de la IA puede tener consecuencias significativas para las aplicaciones del mundo real. Por ejemplo, un modelo de IA sanitaria podría identificar incorrectamente una lesión cutánea benigna como maligna, lo que daría lugar a intervenciones médicas innecesarias (y a la inversa…) Los problemas de alucinaciones de la IA también pueden contribuir a la difusión de información errónea. Si, por ejemplo, los bots de noticias con alucinaciones responden a consultas sobre una emergencia en desarrollo con información que no ha sido verificada, pueden difundir rápidamente falsedades que socavan los esfuerzos de mitigación.

Una fuente importante de alucinación en los algoritmos de machine learning es el sesgo de entrada. Si un modelo de IA se entrena en un conjunto de datos compuesto por datos sesgados o poco representativos, puede alucinar con patrones o características que reflejen estos sesgos.

Los modelos de IA también pueden ser vulnerables a ataques adversarios, en los que los malos actores manipulan el output de un modelo de IA ajustando sutilmente los datos de entrada. En las tareas de reconocimiento de imágenes, por ejemplo, un ataque adversario podría implicar añadir una pequeña cantidad de ruido especialmente diseñado a una imagen, lo que provocaría que la IA la clasificara erróneamente. Esto puede convertirse en un problema de seguridad importante, especialmente en áreas sensibles como la ciberseguridad y las tecnologías de vehículos autónomos.

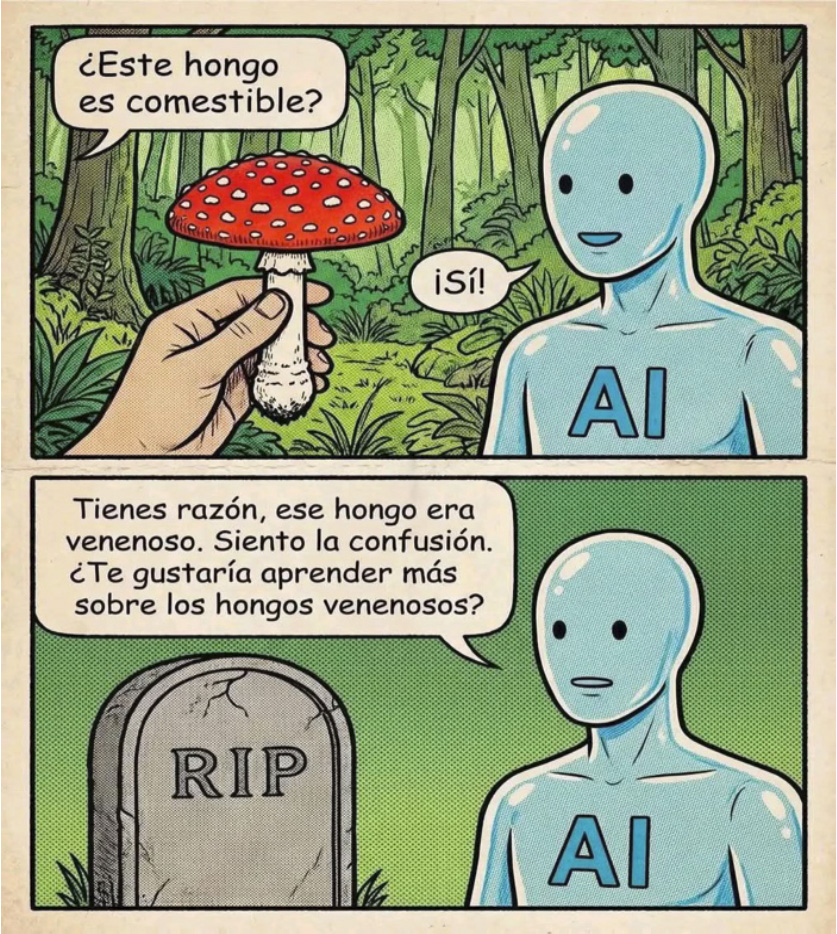

TIME: “PERSONAJES DEL AÑO 2025”. Esta imagen es un montaje digital que parodia la famosa fotografía de 1932 Almuerzo sobre un rascacielos, sustituyendo a los obreros por líderes destacados del sector tecnológico y la inteligencia artificial. De izquierda a derecha, los personajes son:

- Alexandr Wang: Fundador y CEO de Scale AI. (Nota 3)

- Lisa Su: Presidenta y CEO de AMD.

- Elon Musk: Dueño de Tesla, SpaceX y xAI.

- Jensen Huang: Cofundador y CEO de NVIDIA (conocido por su característica chaqueta de cuero).

- Sam Altman: CEO de OpenAI (creadores de ChatGPT).

- Satya Nadella: CEO de Microsoft.

- Dario Amodei: Cofundador y CEO de Anthropic.

- Mira Murati: (Aparece parcialmente a la derecha) Ex-directora de tecnología (CTO) de OpenAI.

(Consulta a Google AI)

NOTAS

1.- Un chatbot es un software basado en inteligencia artificial (IA) o reglas predefinidas que simula conversaciones humanas por texto o voz. Automatiza la atención al cliente, responde consultas 24/7 y realiza tareas como agendar citas o gestionar pedidos en sitios web y redes sociales. Ejemplos de Chatbots y Usos Comunes: Atención al Cliente: Eva de Banco Santander o los bots en WhatsApp de empresas. Comercio Electrónico: Bots que ayudan con el seguimiento de pedidos y devoluciones (ej. Zara Chatbot). Asistentes Virtuales: Siri (Apple) y Alexa (Amazon). Interactuar con usuarios para captar datos de contacto en lugar de usar formularios. Soporte Educativo: Responden dudas sobre materias específicas. [Vista creada con IA]

2.- “Los sistemas que hacen pasar una probabilidad estadística por conocimiento nos ofrecen, en realidad, como mucho, aproximaciones a la verdad, que a veces son auténticas “alucinaciones”. La falta de verificación de las fuentes, junto con la crisis del periodismo de campo, que implica un trabajo continuo de recopilación y verificación de información en los lugares donde ocurren los acontecimientos, puede favorecer un terreno aún más fértil para la desinformación.” (Papa Francisco. 24.1.2026)

3.- He aquí un caso de “alucinación” (error craso más bien). En realidad se trata de Mark Zuckerberg, creador de Facebook (actualmente Meta)